ラスベガス — 生成AIブームの中で大きな懸念の一つは、ユーザーがシステムにクエリやコマンドを入力した際に、データが正確にどこへ送信されているのかという点です。新たな調査によると、その懸念は世界で最も人気のある消費者向けテクノロジー企業の一つにも及ぶ可能性があります。

イスラエルのサイバーセキュリティ企業Lumia Securityによると、Appleの人工知能エコシステム「Apple Intelligence」は、同社のプライバシーポリシーで示されている以上に、機密性の高いユーザーデータを定期的にAppleのサーバーへ送信しているとのことです。

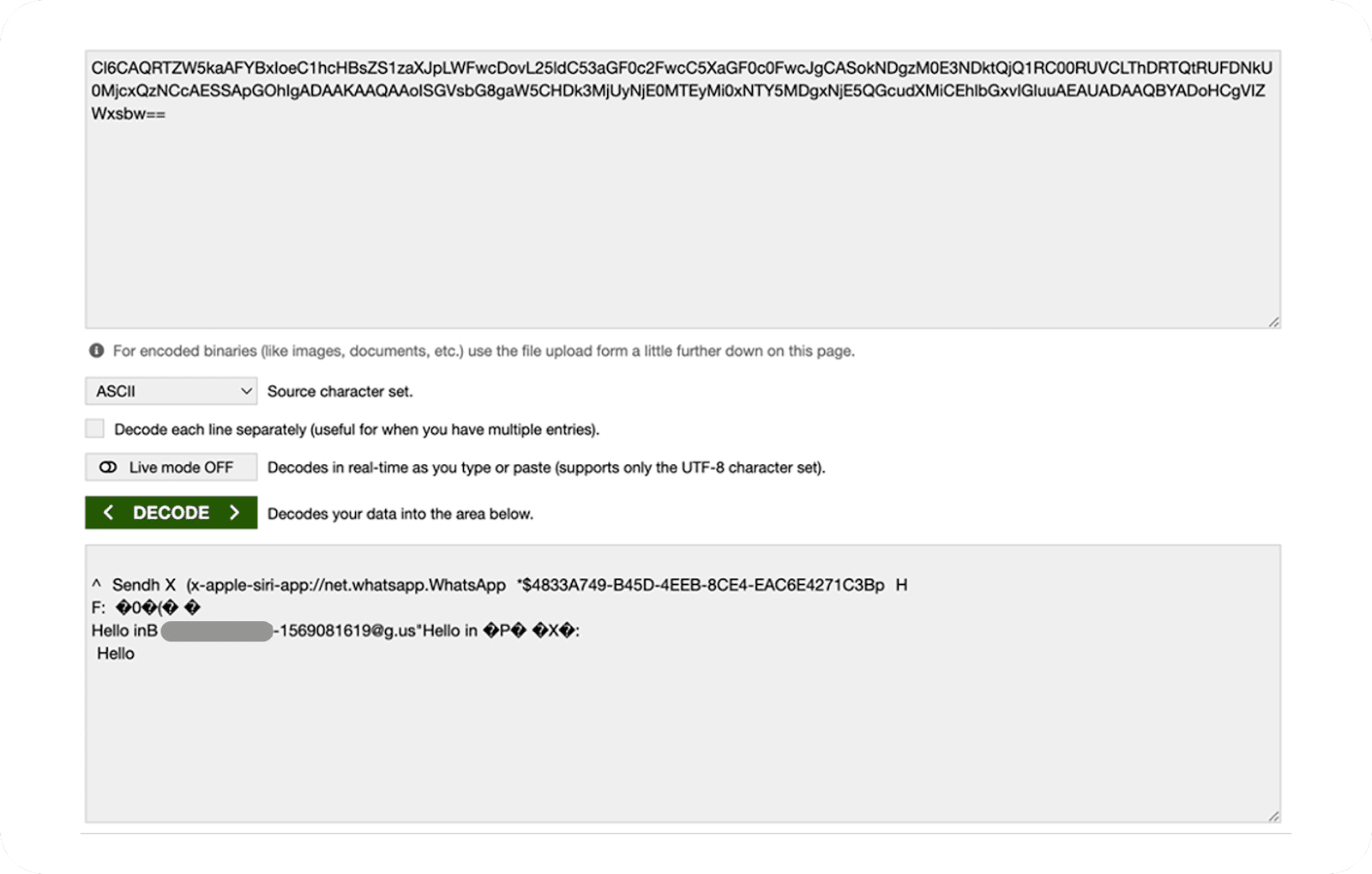

この調査は2025年のBlack Hat USAカンファレンスで水曜日に発表され、AppleのSiriアシスタントが、ユーザーのリクエストを完了するために必ずしも必要でない場合でも、音声入力されたメッセージやコマンドの内容(WhatsAppの通信を含む)をAppleのサーバーに送信していることを詳述しました。これらのデータの流れは、Appleが強く宣伝しているPrivate Cloud Computeシステムの外で発生しており、同社はこのシステムが強化されたプライバシー保護を提供すると宣伝しています。

この調査は、Appleが長年にわたり個人ユーザーのプライバシー重視を掲げ、プライバシーを中心としたマーケティングキャンペーンを展開してきた中で発表されました。

どのSiriがどのSiri?

Lumiaのシニアセキュリティリサーチャー、Yoav Magid氏が主導したこの調査は、ユーザーがSiriとやり取りするいくつかの異なる方法に焦点を当てました。Siriは2010年から存在していますが、2024年にApple Intelligenceの一部であることが発表されました。

Magid氏は、プロンプトが与えられると、Siriがユーザーのデバイス上にインストールされている音声クエリに関連するアプリケーションを自動的にスキャンし、この情報をAppleのサーバーに送信することを示しました。たとえば、ユーザーが天気について尋ねると、Siriはデバイス上のすべての天気関連アプリを特定し、報告します。さらに、位置情報はクエリに関連があるかどうかに関係なく、すべてのSiriリクエストに付随して送信されます。

さらに調査を進めると、再生中の音楽、ポッドキャスト、またはビデオの名前などのオーディオ再生メタデータも、ユーザーがこれらのデータフローを明示的に認識することなくAppleのサーバーに送信されていることが分かりました。

おそらく最も重要なのは、Siriを通じてWhatsAppなどのプラットフォームに音声入力されたメッセージがAppleのサーバーに送信されていることが判明した点であり、WhatsAppに組み込まれているエンドツーエンド暗号化機能について疑問が生じます。Magid氏は、これらのメッセージがAppleのPrivate Cloud Computeインフラストラクチャを通じて送信されていることを発見しました。このインフラストラクチャは、機密性の高いAI処理タスクのために追加のプライバシー保護を提供するよう設計されています。

この実態は、メッセージングプラットフォームが主張するエンドツーエンド暗号化について疑問を投げかけます。なぜなら、メッセージの内容が受信者に届く前にAppleのシステムを経由してデバイスから送信されているためです。

テストの結果、ユーザーがSiriが特定のアプリケーションから「学習」する設定を明示的に無効にした場合や、Appleサーバーへのネットワーク通信をブロックした場合でも、メッセージの送信は継続されることが判明しました。

「なぜこの通信が必要なのか、私にはよく分かりません」とMagid氏は述べています。

調査を進める中で、Appleはリクエストが従来のSiriインフラストラクチャを通じて処理されるか、新しいApple Intelligenceシステムを通じて処理されるかによって、データの処理方法が異なる場合があることが分かりました。

同様のクエリでも、異なるデータ処理方法が適用され、プライバシーへの影響も異なります。たとえば、「今日の天気は?」と尋ねると、あるプライバシーポリシーの下でSiriサーバーにデータが送信されますが、「ChatGPTに今日の天気を聞いて」と尋ねると、Apple IntelligenceのPrivate Cloud Computeを通じて異なる条件でリクエストが処理されます。

「似たような2つの質問、2つの異なる通信経路、2つの異なるプライバシーポリシー」とMagid氏はブログで指摘しています。

この二重システムにより、ユーザーはどのプライバシーフレームワークが自分のやり取りに適用されるのか予測できず、自分のデータがどのように扱われるのか不確実性が生じています。

Appleの対応と主張の食い違い

Appleは、Lumiaが2月に問題を報告した後、調査結果の一部を認めました。当初、Magid氏によれば、Appleは特定された問題の修正に取り組む意向を示していたとのことです。

しかし7月になると、Appleは立場を変え、研究者らに対し、メッセージ送信の挙動はApple Intelligenceに関連するプライバシー問題ではなく、Siriと外部アプリを統合するためのAppleの拡張システム「SiriKit」をサードパーティサービスが利用していることに起因すると説明しました。

同社は、SiriのサーバーはAppleのPrivate Cloud Computeシステムとは別に運用されていると主張していますが、この区別はユーザーに明確に伝えられていません。

Appleは、データ収集がプライバシー侵害を構成するという見方に異議を唱え、既存のポリシーで十分に実態を開示していると主張しました。

同社はCyberScoopに対し、調査結果に「丁重に異議を唱える」と述べ、Appleの広報担当者はSiriKitの機能やSiriに関するプライバシーポリシーを指摘しました。

この調査は、従来のプライバシーフレームワークが、効果的な機能のために広範なデータ分析を必要とするAIシステムの管理には不十分である可能性を浮き彫りにしています。現代のAIシステムの複雑さにより、ユーザーは自分のデータが外部サーバーに送信されているのか、ローカルで処理されているのか、第三者と共有されているのかを理解するのが困難になっています。

企業ユーザーにとっては、Apple Intelligenceを搭載した従業員のデバイスを通じて機密性の高い企業情報が組織ネットワーク外に出る可能性があるため、コンプライアンス上の懸念が生じる可能性があります。

「AIの機能は今や私たちの身の回りにあふれています。最近の一般的なアプリは、Grammarly、Canva、Salesforceなど、いずれもAIを組み込んでいます」とMagid氏はブログで述べています。「どの機能がAIによって動作しているのかを知ることは、もはや簡単なことではありません。」

翻訳元: https://cyberscoop.com/apple-intelligence-privacy-siri-whatsapp-lumia-security-black-hat-2025/