本記事では、Pillar Securityのプラットフォームの概要を簡単にご紹介し、彼らがどのようにAIセキュリティの課題に取り組んでいるかを理解します。

Pillar Securityは、AIシステムへの信頼を提供することを目標に、ソフトウェア開発およびデプロイメントのライフサイクル全体をカバーするプラットフォームを構築しています。包括的なアプローチを用いて、プラットフォームはAIの脅威を検出する新しい方法を導入し、計画前の段階から実行時までカバーします。この過程で、ユーザーはアプリケーションのセキュリティ状況を可視化し、安全なAI実行を可能にします。

PillarはAIセキュリティに固有の課題に対して独自の適性を持っています。共同創業者兼CEOのDor Sarigは、政府機関や企業向けに10年以上セキュリティオペレーションを指揮したサイバー攻撃側のバックグラウンドを持っています。一方、共同創業者兼CTOのZiv Karlingerは、金融サイバー犯罪対策やサプライチェーンのセキュリティなど、防御技術の開発に10年以上従事してきました。彼らのレッドチーム(攻撃側)とブルーチーム(防御側)のアプローチがPillar Securityの基盤となり、脅威の軽減に大きく貢献しています。

アプローチの背後にある哲学#

プラットフォームの詳細に入る前に、Pillarが採用している根本的なアプローチを理解することが重要です。Pillarは、プラットフォームの各要素が単一の領域だけに特化したサイロ型システムを開発するのではなく、包括的なアプローチを提供します。プラットフォーム内の各コンポーネントが次の要素を強化し、セキュリティが各ユースケースに適応できるクローズドループのフィードバックを生み出します。

プラットフォームのポスチャーマネジメントセクションで検出された内容は、ディスカバリーセクションで検出されたデータによって強化されます。同様に、実行時に利用されるアダプティブガードレールは、脅威モデリングやレッドチーミングから得られた知見に基づいて構築されます。この動的なフィードバックループにより、新たな脆弱性が発見されるたびにライブ防御が最適化されます。このアプローチは、開発から実行時までAIシステムへの脅威に対して強力で包括的かつ文脈に基づいた防御を実現します。

AIワークベンチ:AIの始まりでの脅威モデリング#

Pillar Securityプラットフォームは、彼らが「AIワークベンチ」と呼ぶ場所から始まります。コードが書かれる前に、脅威モデリングのためのこの安全なプレイグラウンドで、セキュリティチームはAIのユースケースを試し、潜在的な脅威を事前にマッピングできます。この段階は、組織がAIシステムを企業ポリシーや規制要件に合わせるために重要です。

開発者やセキュリティチームは、アプリケーションのユースケースに特化した潜在的な攻撃シナリオを生成する、構造化された脅威モデリングプロセスを通じてガイドされます。リスクはアプリケーションのビジネスコンテキストに合わせて調整され、このプロセスはSTRIDE、ISO、MITRE ATLAS、LLM向けOWASP Top Ten、Pillar独自のSAILフレームワークなどの確立されたフレームワークに準拠しています。目的は、設計段階からセキュリティと信頼を組み込むことです。

AIディスカバリー:AI資産へのリアルタイム可視化#

AIスプロールは、セキュリティおよびガバナンスチームにとって複雑な課題です。彼らは開発および本番環境でAIがどのように、どこで使われているかを把握できていません。

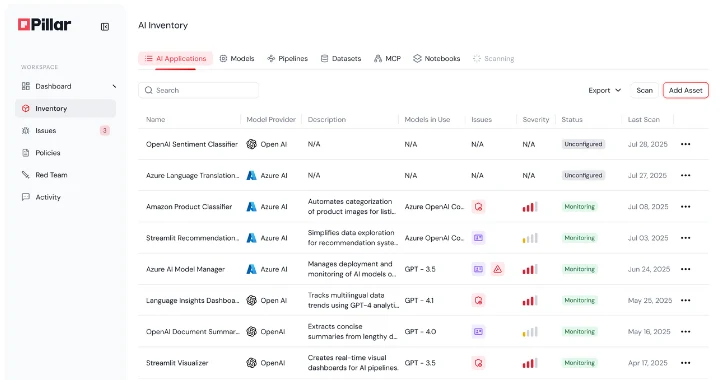

Pillarは、CI/CDパイプラインや従来のSDLCを超えた独自のAIセキュリティアプローチを取っています。コードリポジトリ、データプラットフォーム、AI/MLフレームワーク、IdP、ローカル環境に直接統合することで、組織内のすべてのAI資産を自動的に発見・カタログ化できます。プラットフォームは、モデル、ツール、データセット、MCPサーバー、コーディングエージェント、メタプロンプトなどを含むAIアプリの全インベントリを表示します。この可視性により、チームは組織のセキュリティポリシーの基盤を形成し、アプリケーションの内容や組織での利用方法など、ビジネスユースケースの明確な理解を得ることができます。

|

| 図1:Pillar Securityは組織全体のすべてのAI資産を自動的に発見し、監視されていないコンポーネントをフラグ付けしてセキュリティの死角を防ぎます。 |

AI-SPM:AIリスクのマッピングと管理#

すべてのAI資産を特定した後、Pillarは各資産を分析することでセキュリティポスチャーを把握できます。この段階で、プラットフォームのAIセキュリティポスチャーマネジメント(AI-SPM)は、すべてのAI資産とその相互接続について強力な静的・動的分析を実施します。

AI資産を分析することで、Pillarは特定されたエージェンティックシステム、その構成要素、および関連する攻撃対象領域の視覚的な表現を作成します。さらに、サプライチェーン、データポイズニング、モデル/プロンプト/ツールレベルのリスクを特定します。これらの知見はプラットフォーム内に表示され、脅威アクターがシステム内をどのように移動できるかを正確に示すことで、チームが脅威の優先順位付けを可能にします。

|

| 図2:Pillarのポリシーセンターは、企業全体のAIコンプライアンス状況を監視するための集中ダッシュボードを提供します |

AIレッドチーミング:攻撃が起こる前にシミュレーション#

アプリケーションが完全に構築されるまで待つのではなく、Pillarは「設計による信頼」アプローチを推進し、AIチームが構築しながらテストできるようにします。

プラットフォームは、プロンプトインジェクションやジェイルブレイキングなどの一般的な手法から、ビジネスロジックの脆弱性を狙った高度な攻撃まで、AIシステムのユースケースに合わせたシミュレート攻撃を実行します。これらのレッドチーム活動により、AIエージェントが不正な返金を行ったり、機密データを漏洩させたり、意図しないツール操作を実行したりできるかどうかを特定できます。このプロセスはモデルだけでなく、より広範なエージェンティックアプリケーションや外部ツール・APIとの統合も評価します。

Pillarは、ツール利用のためのレッドチーミングを通じて独自の機能も提供します。プラットフォームは脅威モデリングと動的ツールアクティベーションを統合し、連鎖したツールやAPI呼び出しが現実的な攻撃シナリオでどのように悪用されるかを厳密にテストします。この高度なアプローチにより、従来のプロンプトベースのテスト手法では検出できない脆弱性が明らかになります。

コパイロットやカスタムチャットボットなど、サードパーティや組み込みAIアプリを利用する企業向けには、Pillarはブラックボックス型・ターゲットベースのレッドチーミングを提供します。URLと認証情報だけで、Pillarの攻撃エージェントは内部・外部を問わずアクセス可能なAIアプリケーションをストレステストできます。これらのエージェントは実際の攻撃をシミュレートし、データ境界を探り、露出リスクを明らかにすることで、組織がサードパーティAIシステムを統合やカスタマイズなしで安全に評価・保護できるようにします。

|

| 図3:Pillarのカスタマイズされたレッドチーミングは、AIアプリケーションの特定ユースケースとビジネスロジックに対する実際の攻撃シナリオをテストします |

ガードレール:学習する実行時ポリシー強制#

AIアプリケーションが本番環境に移行すると、リアルタイムのセキュリティコントロールが不可欠になります。Pillarは、実行時に入力と出力を監視し、アプリケーションのパフォーマンスを妨げることなくセキュリティポリシーを強制するアダプティブガードレールのシステムでこのニーズに対応します。

従来の静的ルールセットやファイアウォールとは異なり、これらのガードレールはモデル非依存、アプリケーション中心で継続的に進化します。Pillarによれば、これらはテレメトリデータ、レッドチーミングで得られた知見、脅威インテリジェンスフィードを活用し、新たな攻撃手法にリアルタイムで適応します。これにより、各アプリケーションのビジネスロジックや挙動に基づいて強制を調整し、アラートの精度を高めます。

ウォークスルーでは、ガードレールがデータ流出や意図しないアクションなどの悪用を防ぎつつ、AI本来の動作を維持するよう細かく調整できる様子が見られました。組織は、AIポリシーやカスタム行動規範をアプリケーション全体で確実に強制し、セキュリティと機能性の両立を実現できます。

|

| 図4:Pillarのアダプティブガードレールは実行時の活動を監視し、不正利用やポリシー違反を検知・フラグ付けします |

サンドボックス:エージェンティックリスクの封じ込め#

最も重要な懸念事項の一つは、過度なエージェンシー(自律性)です。エージェントが本来の範囲を超えた行動を取れる場合、意図しない結果を招く可能性があります。

Pillarは運用フェーズで安全なサンドボックス化を通じてこれに対処します。コーディングエージェントやMCPサーバーなどの高度なAIエージェントも含め、厳格に制御された環境内で動作します。これらの隔離された実行環境はゼロトラスト原則を適用し、エージェントを重要なインフラや機密データから分離しつつ、生産的な運用を可能にします。予期しない、または悪意のある行動はシステム全体に影響を与えることなく封じ込められます。すべてのアクションは詳細に記録され、チームは後から分析できる詳細なフォレンジックトレイルを得られます。この封じ込め戦略により、組織はAIエージェントに必要な運用の自由を安全に与えることができます。

AIテレメトリ:プロンプトからアクションまでの可観測性#

アプリケーションが稼働を開始しても、セキュリティは終わりません。Pillarはライフサイクル全体を通じて、AIスタック全体のテレメトリデータを継続的に収集します。プロンプト、エージェントのアクション、ツール呼び出し、コンテキストメタデータなどがリアルタイムで記録されます。

このテレメトリは、詳細な調査やコンプライアンス追跡に活用されます。セキュリティチームは、インシデントの症状から根本原因まで追跡し、異常な挙動を理解し、AIシステムがポリシーの範囲内で動作していることを確認できます。何が起きたかを知るだけでは不十分です。なぜそれが起きたのか、再発をどう防ぐかを理解することが重要です。

テレメトリデータの機密性に配慮し、Pillarは顧客のクラウド上にデプロイして完全なデータコントロールを実現できます。

まとめ#

Pillarは、技術的な深さ、現実世界での洞察、エンタープライズグレードの柔軟性を兼ね備えている点で際立っています。

攻撃側・防御側双方のサイバーセキュリティリーダーによって設立されたチームは、重大な脆弱性を発見し、詳細な実世界の攻撃レポートを作成してきた実績があります。この専門知識はプラットフォームのあらゆるレベルに組み込まれています。

Pillarはまた、CI/CDパイプラインを超えた包括的なAIセキュリティアプローチを取っています。計画・コーディング段階でセキュリティを組み込み、コードリポジトリ、データプラットフォーム、ローカル環境に直接接続することで、構築中のシステムへの早期かつ深い可視性を得ています。このコンテキストにより、開発が進むにつれてより正確なリスク分析とターゲットを絞ったレッドチームテストが可能になります。

プラットフォームは業界最大規模のAI脅威インテリジェンスフィードによって強化され、1,000万件以上の実世界のインタラクションで豊富な脅威データを蓄積しています。この脅威データは自動テスト、リスクモデリング、脅威環境の変化に適応する防御機能を支えています。

さらに、Pillarは柔軟なデプロイメントに対応しています。オンプレミス、ハイブリッド環境、完全クラウドのいずれでも稼働でき、顧客は機密データ、プロンプト、独自モデルを完全にコントロールできます。これは、データの所在やセキュリティが最重要となる規制産業にとって大きな利点です。

これらの機能が組み合わさることで、Pillarは大規模な安全なAI導入のための強力かつ実用的な基盤となり、革新的な組織がAI固有のリスクを管理し、AIシステムへの信頼を獲得するのを支援します。

翻訳元: https://thehackernews.com/2025/07/product-walkthrough-look-inside-pillars.html